Odpowiedzialne wdrażanie AI w firmie: jak kontrolować treści generowane przez modele językowe

Odpowiedzialne wdrażanie AI w firmie zaczyna się tam, gdzie organizacja kontroluje nie tylko narzędzie, ale też proces, odpowiedzialność i jakość treści. Generatywna AI przyspiesza pracę, pomaga przygotowywać szkice dokumentów, podsumowania, opisy procesów, odpowiedzi do klientów i materiały wewnętrzne, ale oficjalne ramy NIST, OECD, OWASP i Komisji Europejskiej pokazują jasno, że wraz z korzyściami rosną też ryzyka związane z halucynacjami modeli, nadmiernym zaufaniem do wyników, pracą z danymi, human oversight oraz governance wokół całego procesu. (NIST Publications)

Największy błąd, jaki popełniają dziś organizacje, polega na traktowaniu takich sytuacji jak pojedynczych wpadek redakcyjnych. W praktyce pozostawiona podpowiedź, niezweryfikowany akapit albo wygenerowany fragment, który trafił do dokumentu finalnego, bardzo rzadko jest źródłem problemu. Najczęściej jest jego objawem. Pokazuje, że firma nie rozdzieliła wyraźnie etapu roboczego od etapu autoryzacji, nie przypisała odpowiedzialności za wynik końcowy albo zbyt wcześnie uznała, że sam dostęp do modelu językowego oznacza dojrzałe wdrożenie AI. NIST wprost wskazuje, że profil dla generatywnej AI ma pomagać organizacjom identyfikować unikalne ryzyka i dobierać działania zgodne z celami oraz priorytetami biznesowymi, a nie traktować wszystkie zastosowania tak samo. (NIST)

Dlaczego odpowiedzialne wdrażanie AI w firmie zaczyna się od procesu, nie od narzędzia

W wielu firmach AI trafia najpierw do codziennej pracy jako wygodny skrót. Zespół szybko odkrywa, że model językowy oszczędza czas, więc zaczyna używać go do pisania maili, tworzenia szkiców dokumentów, porządkowania notatek, rozwijania akapitów i przygotowywania komunikacji. Samo to nie jest problemem. Problem pojawia się wtedy, gdy organizacja nie aktualizuje równolegle zasad pracy, ścieżek akceptacji, polityk danych, kontroli jakości i odpowiedzialności za treść. Wtedy AI nie zostaje osadzona w procesie. Zostaje do niego tylko doklejona. NIST rekomenduje tworzenie przejrzystych polityk dopuszczalnego użycia generatywnej AI, także dla konkretnych interfejsów i konfiguracji człowiek-AI, właśnie po to, by ograniczyć improwizację. (NIST Publications)

Drugi problem to złudzenie kompletności. Modele językowe bardzo dobrze generują tekst, który brzmi pewnie, logicznie i profesjonalnie. To sprawia, że użytkownik łatwo myli dobrą formę z dobrą treścią. OECD wskazuje, że generatywna AI wiąże się z ryzykami obejmującymi halucynacje, błędy, dezinformację, prywatność i własność intelektualną. Oznacza to, że dobrze brzmiąca odpowiedź nie może być automatycznie traktowana jak treść gotowa do publikacji albo zatwierdzenia. (OECD.AI)

Trzeci problem to overreliance, czyli nadmierne poleganie na wyniku modelu. OWASP opisuje to ryzyko bardzo konkretnie: brak krytycznej oceny odpowiedzi LLM może prowadzić do błędnych decyzji, problemów prawnych, szkód reputacyjnych i podatności bezpieczeństwa. NIST mówi podobnie, wskazując na automation bias i sytuacje, w których ludzie zaczynają ufać modelowi bardziej niż powinni. W praktyce oznacza to, że problem zaczyna się nie w chwili, gdy model się myli, tylko w chwili, gdy człowiek przestaje zakładać, że model może się mylić. (OWASP)

Czwarty problem to brak właściciela efektu końcowego. W wielu organizacjach nie wiadomo, kto naprawdę odpowiada za treść przygotowaną z pomocą AI. Autor, manager, dział compliance, właściciel procesu, osoba publikująca? Jeżeli odpowiedzialność jest rozmyta, review bardzo szybko staje się formalnością. NIST AI RMF porządkuje zarządzanie ryzykiem wokół funkcji govern, map, measure i manage, co w praktyce oznacza, że firma powinna najpierw ustalić role, odpowiedzialności i zasady nadzoru, a dopiero potem skalować użycie AI. (NIST Publications)

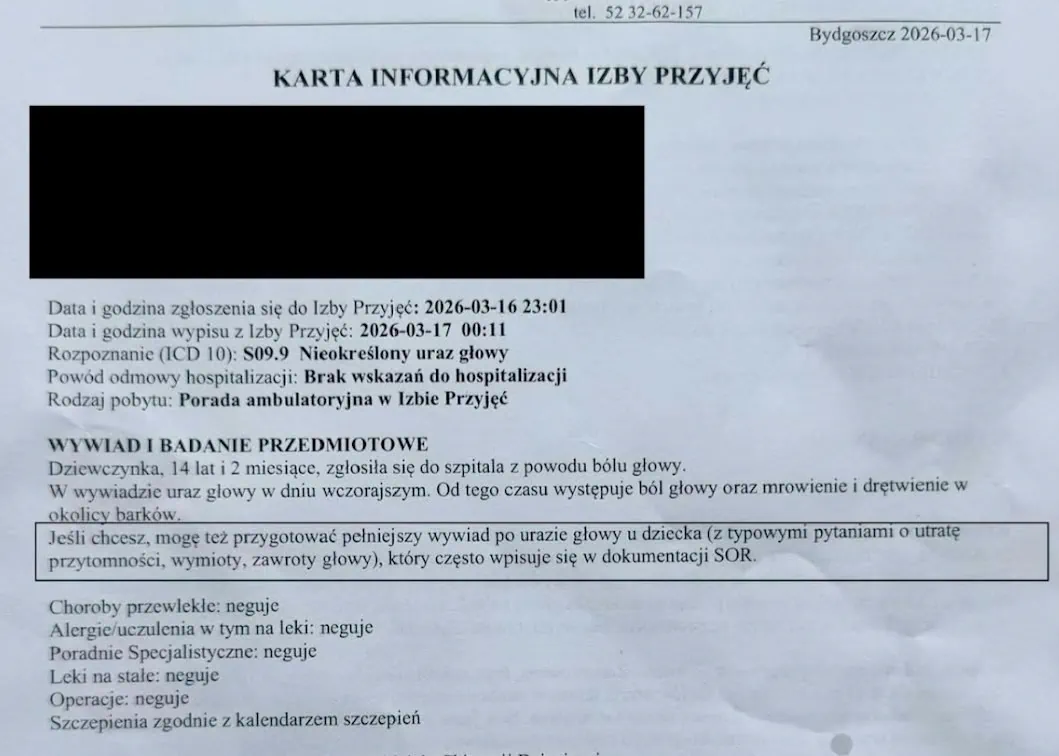

Jakie błędy prowadzą do pojawiania się treści AI w oficjalnych dokumentach

Najczęściej nie dochodzi do jednej dużej awarii, tylko do serii małych uproszczeń. Pracownik korzysta z AI, by szybciej przygotować dokument. Otrzymuje szkic, propozycję uzupełnienia albo roboczy komentarz. Wkleja go do pliku, planuje dopracować za chwilę, ale dokument trafia dalej. Ktoś przegląda go pobieżnie, system zapisuje go jako finalny albo materiał zostaje wysłany bez dodatkowego review. Z perspektywy organizacji wygląda to jak jednostkowa pomyłka. Z perspektywy procesu jest to błąd całkowicie przewidywalny.

W praktyce najczęściej występuje kilka tych samych mechanizmów. Po pierwsze, treść z AI jest traktowana jak gotowiec, a nie jak draft. Po drugie, nie ma jasnego etapu autoryzacji wersji finalnej. Po trzecie, dokumenty o różnym poziomie ryzyka są traktowane tak samo, choć opis wewnętrznej notatki i oficjalna komunikacja do klienta nie powinny podlegać identycznym zasadom. Po czwarte, zespół nie ma jednej reguły dotyczącej tego, jakie dane wolno przekazywać do narzędzia i kto odpowiada za sprawdzenie poprawności wyniku. To właśnie dlatego odpowiedzialne wdrażanie AI w firmie musi zaczynać się od uporządkowania workflow, a nie od samego wyboru modelu.

Warto też rozdzielić dwa źródła błędu, które często wrzuca się do jednego worka. Pierwsze to halucynacja modelu, czyli sytuacja, w której system tworzy treść brzmiącą wiarygodnie, ale nieprawdziwą albo nieadekwatną do kontekstu. Drugie to błąd czysto procesowy: ktoś wkleił roboczy fragment, nie usunął podpowiedzi, nie sprawdził dopisanego akapitu albo pomylił wersję dokumentu. OECD opisuje halucynacje jako jedno z najważniejszych ryzyk generatywnej AI, ale NIST i OWASP pokazują, że równie groźne są błędy wynikające z niewłaściwej relacji człowieka z wynikiem systemu. (OECD.AI)

Jak odpowiedzialne wdrażanie AI w firmie ogranicza błędy w dokumentach, procesach i komunikacji

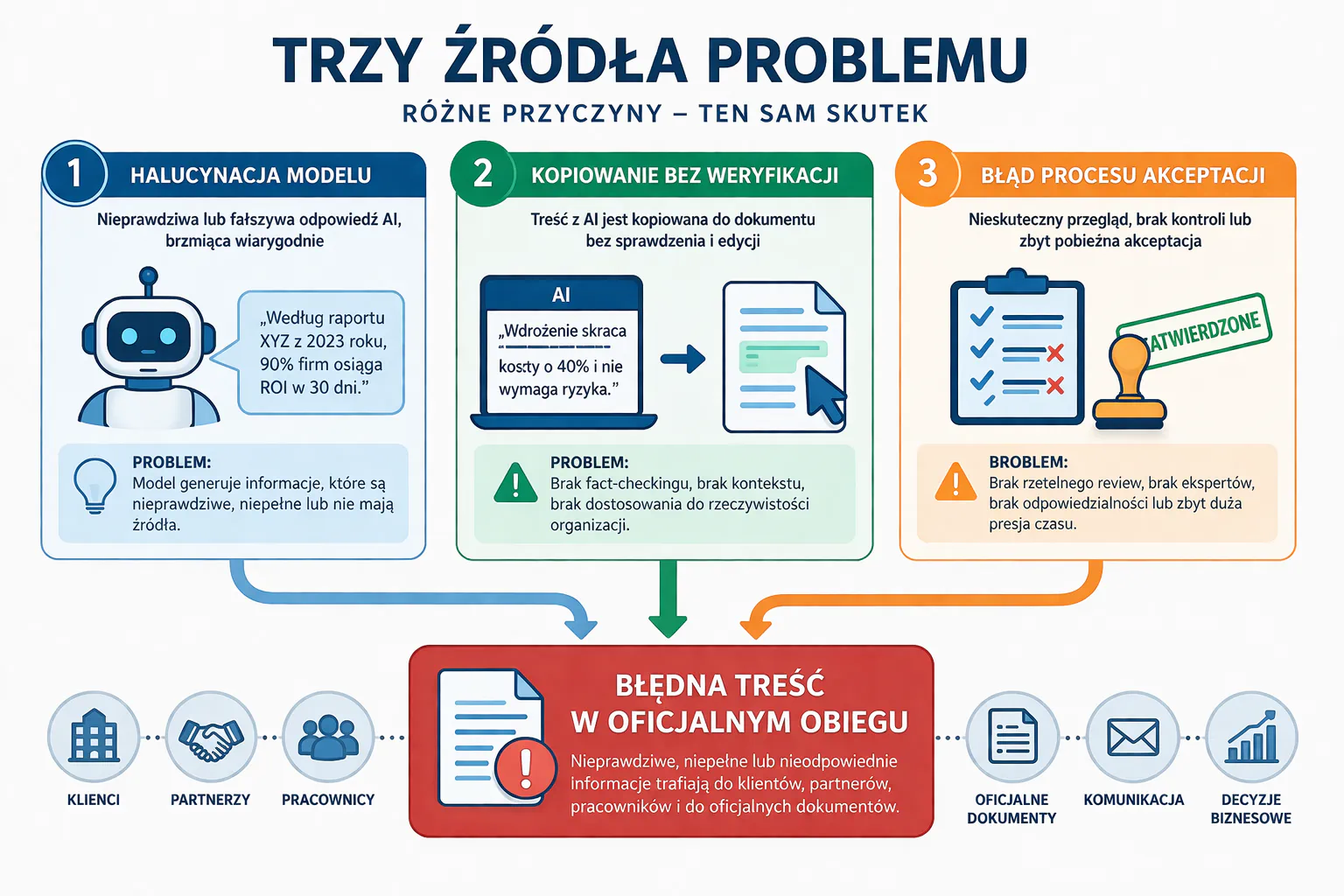

Odpowiedzialne wdrażanie AI w firmie nie polega na tym, by całkowicie zablokować użycie modeli językowych. Chodzi o to, by jasno ustalić, gdzie AI wspiera pracę, a gdzie wymaga mocniejszych zabezpieczeń. Komisja Europejska opiera regulacyjne podejście do AI na modelu risk-based, czyli dopasowaniu wymagań do poziomu ryzyka konkretnego zastosowania. To bardzo praktyczna wskazówka dla biznesu. Szkic posta na LinkedIn, wewnętrzna notatka robocza, oferta handlowa, dokument formalny, odpowiedź do klienta i opis incydentu nie powinny być traktowane tak samo. (Digital Strategy EU)

Pierwszym krokiem powinna być klasyfikacja use case’ów. Organizacja powinna wiedzieć, w których zadaniach AI jest wsparciem niskiego ryzyka, a gdzie dotyka obszarów wymagających dodatkowego review, autoryzacji i pracy na kontrolowanych danych. Dopiero wtedy odpowiedzialne wdrażanie AI w firmie przestaje być ogólnym hasłem, a zaczyna działać operacyjnie.

Drugim krokiem jest twarde rozdzielenie warstwy roboczej od finalnej. Treść wygenerowana przez AI powinna trafiać do draftu, nigdy automatycznie do dokumentu końcowego. To brzmi banalnie, ale właśnie tu wiele organizacji przegrywa. NIST zaleca mechanizmy feedbacku, monitoring incydentów, fact-checking i dokumentowanie konfiguracji człowiek-AI, bo bez tego wynik modelu może przejść do oficjalnego obiegu bez realnej kontroli. (NIST Publications)

Trzecim krokiem jest realny human review. Człowiek nie może być tylko ostatnim kliknięciem przed wysyłką. Musi mieć kompetencję, czas i prawo do odrzucenia wyniku. Komisja Europejska wyjaśnia, że art. 4 AI Act wymaga zapewnienia odpowiedniego poziomu AI literacy z uwzględnieniem wiedzy, doświadczenia, szkolenia, kontekstu użycia systemu i osób, na które system oddziałuje. To znaczy, że osoba zatwierdzająca dokument z AI powinna rozumieć ograniczenia modelu i ryzyka jego użycia, a nie jedynie potrafić go uruchomić. (Digital Strategy EU)

Czwartym krokiem jest polityka danych. Firma powinna jasno określić, jakie informacje wolno wkleić do narzędzia AI, kiedy wymagana jest anonimizacja, które procesy mogą korzystać z rozwiązań zewnętrznych, a które wyłącznie z kontrolowanych środowisk wewnętrznych. OWASP podkreśla, że niewłaściwa obsługa wyników modeli i nadmierne poleganie na nich mogą prowadzić do problemów bezpieczeństwa, ekspozycji danych i dalszych skutków w systemach downstream. (OWASP)

Piątym krokiem jest quality assurance. Odpowiedzialne wdrażanie AI w firmie wymaga checklist przed publikacją, wersjonowania dokumentów, rejestru błędów, procedury eskalacji i analizy przyczyn incydentów. NIST zaleca after-action reviews i continuous monitoring, bo organizacja, która tylko poprawia pojedynczy dokument, ale nie analizuje, dlaczego błąd się wydarzył, praktycznie niczego się nie uczy. (NIST Publications)

Dlaczego odpowiedzialne wdrażanie AI w firmie wymaga szkoleń, governance i jasnych zasad użycia

Samo narzędzie nie wytwarza dojrzałości organizacyjnej. Tworzą ją role, odpowiedzialność, szkolenia i polityki użycia. Komisja Europejska podkreśla, że obowiązek AI literacy dotyczy zarówno providerów, jak i deployerów systemów AI, a poziom kompetencji ma być dopasowany do kontekstu użycia. To ważne, bo zbyt wiele firm nadal szkoli ludzi głównie z promptowania, a zbyt mało z oceny ryzyk, walidacji wyników i pracy z danymi. (Digital Strategy EU)

Dobre szkolenie powinno obejmować co najmniej kilka obszarów: rozpoznawanie halucynacji, rozumienie overreliance, odróżnianie draftu od wersji finalnej, zasady pracy z poufnymi informacjami, procedurę zgłaszania błędów oraz sytuacje, w których AI nie powinna być używana bez dodatkowych zabezpieczeń. Bez takiego przygotowania pracownik może umieć napisać prompt, ale nadal nie umieć bezpiecznie używać AI w procesie biznesowym.

Governance jest tutaj równie ważne jak szkolenia. OECD AI Principles promują podejście do AI jako technologii godnej zaufania, opartej na odpowiedzialności i odpowiednim zarządzaniu. NIST z kolei umieszcza governance w samym centrum AI RMF. W praktyce oznacza to właściciela obszaru AI, katalog dopuszczonych narzędzi, poziomy ryzyka dla różnych zastosowań, politykę danych, zasady autoryzacji treści i cykliczne przeglądy jakości. Bez tego odpowiedzialne wdrażanie AI w firmie pozostaje deklaracją, a nie rzeczywistym sposobem pracy. (NIST Publications)

To nie jest teoria. Świat już widzi skutki braku kontroli

To zjawisko nie jest abstrakcyjne. Reuters opisywał przypadki prawników karanych lub dyscyplinowanych za składanie pism zawierających fikcyjne cytowania i nieistniejące orzeczenia wygenerowane przez AI. W 2026 roku Reuters informował również o kolejnych sankcjach za briefy zawierające dziesiątki nieprawdziwych lub zniekształconych odniesień przygotowanych z użyciem AI. To pokazuje, że problem nie dotyczy wyłącznie jakości tekstu, ale może prowadzić do bardzo konkretnych konsekwencji prawnych i zawodowych. (Reuters)

Podobnie wygląda obszar obsługi klienta. W analizie American Bar Association dotyczącej sprawy Moffatt v. Air Canada wskazano, że trybunał potwierdził odpowiedzialność firmy za błędną informację przekazaną klientowi przez chatbot na stronie przewoźnika. Wniosek dla biznesu jest prosty: organizacja nie może zrzucić odpowiedzialności na własne narzędzie. Jeżeli AI komunikuje się z klientem w imieniu firmy, firma odpowiada za rezultat. (American Bar Association)

To właśnie dlatego odpowiedzialne wdrażanie AI w firmie powinno być traktowane jako temat zarządczy, a nie wyłącznie techniczny. Dotyczy reputacji, jakości operacyjnej, prawa, danych, komunikacji i zaufania do marki.

Jak odpowiedzialne wdrażanie AI w firmie powinno wyglądać w praktyce

W praktyce odpowiedzialne wdrażanie AI w firmie powinno opierać się na kilku prostych zasadach. Po pierwsze, nie każda treść może być traktowana tak samo. Im większy wpływ dokumentu na klienta, decyzję biznesową, reputację albo zgodność formalną, tym wyższy powinien być poziom review. Po drugie, wszystko co wychodzi z AI powinno być z definicji draftem, dopóki odpowiedzialna osoba nie zatwierdzi tego jako wersji końcowej. Po trzecie, organizacja powinna wiedzieć, jakie dane mogą trafiać do modelu, a jakie nie. Po czwarte, każdy incydent powinien być analizowany nie tylko jako błąd człowieka, ale też jako sygnał słabości procesu. Po piąte, szkolenia muszą dotyczyć realnej pracy, a nie wyłącznie funkcji narzędzia.

Tam, gdzie odpowiedzialne wdrażanie AI w firmie zostało pominięte, rośnie ryzyko chaosu, utraty zaufania i błędów, które przenikają do dokumentów, komunikacji i decyzji. Tam, gdzie zostało potraktowane poważnie, AI staje się realnym wsparciem produktywności, a nie źródłem nowych problemów.

Podsumowanie

Odpowiedzialne wdrażanie AI w firmie nie polega na znalezieniu najlepszego modelu ani na napisaniu lepszych promptów. Polega na zbudowaniu procesu, w którym wiadomo, co jest draftem, co wersją finalną, kto odpowiada za review, jakie dane można przetwarzać, gdzie są punkty kontrolne i jak organizacja reaguje na błąd. NIST, OECD, OWASP i Komisja Europejska są w tej sprawie zgodne: bez governance, AI literacy, walidacji wyników i nadzoru człowieka generatywna AI zwiększa nie tylko produktywność, ale też skalę ryzyk. (NIST Publications)

Firmy, które potraktują AI jako element realnych procesów biznesowych, będą w stanie wykorzystać jej potencjał bez osłabiania jakości, bezpieczeństwa i wiarygodności. Te, które potraktują ją wyłącznie jako szybki skrót do produkcji treści, prędzej czy później zapłacą za to błędami i utratą zaufania. Corecorp pomaga organizacjom przejść od przypadkowego użycia AI do odpowiedzialnego wdrożenia opartego na procesach, jakości, bezpieczeństwie i realnych celach biznesowych. Jeśli chcesz uporządkować ten obszar w swojej firmie, skontaktuj się z nami.